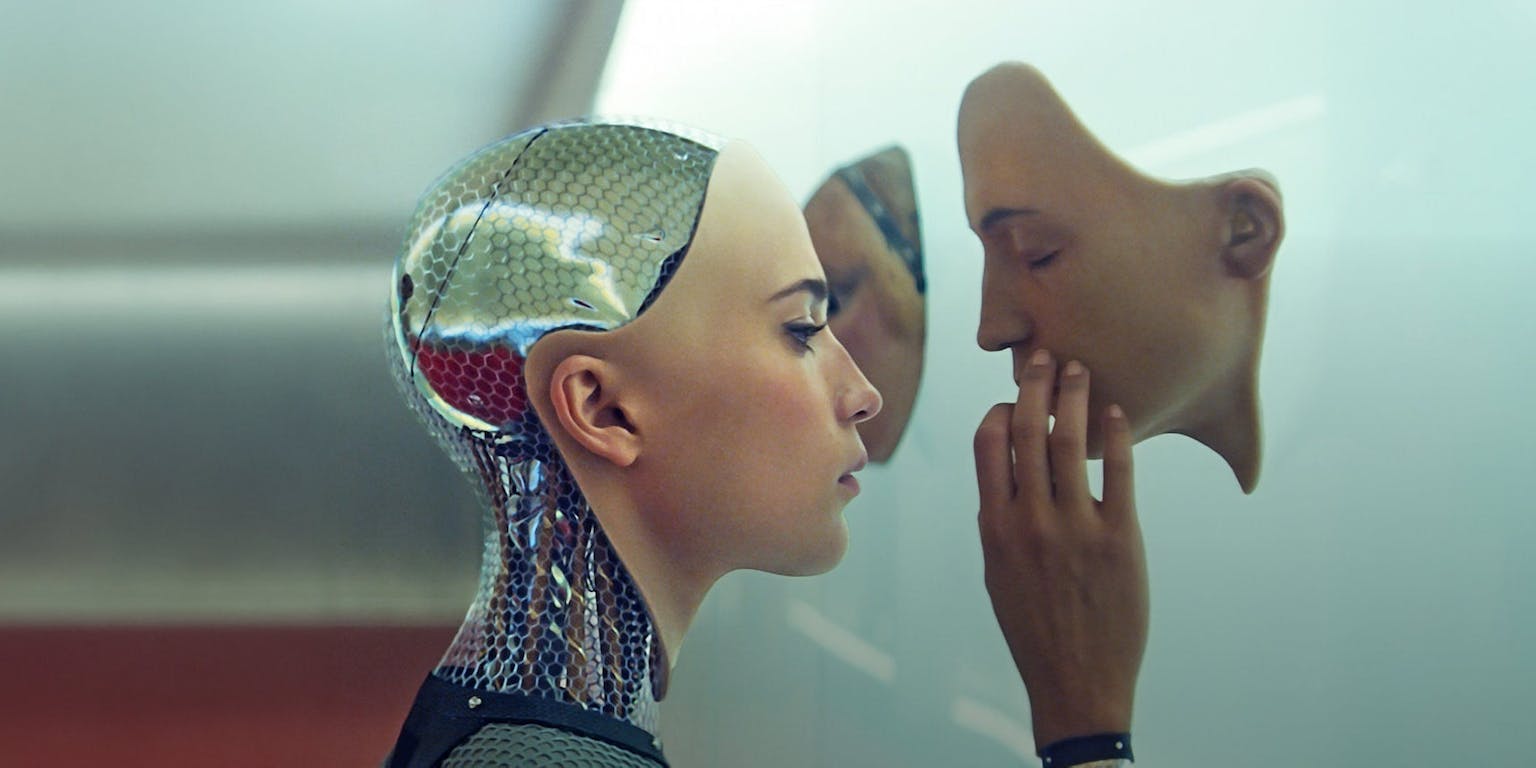

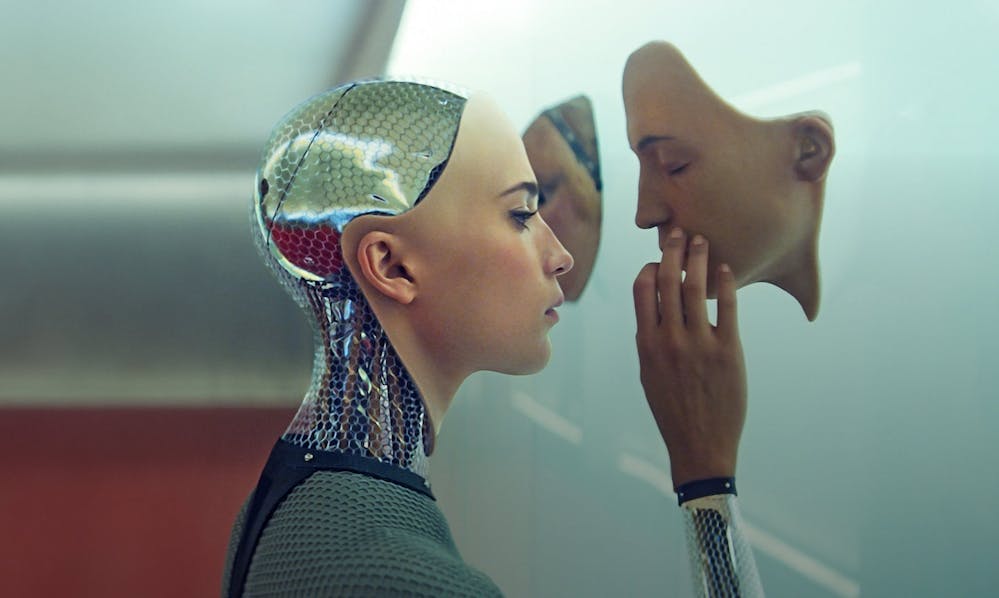

Tien jaar geleden schetste sciencefictionfilm ‘Ex Machina’ een grimmig toekomstbeeld wanneer de lijn tussen mens en machine vervaagt. Hoe is – tien jaar later – onze relatie met AI nu?

“Voel je je tot me aangetrokken?” Caleb kijkt Ava vertwijfeld aan: “Wat?!” “Voel je je tot mij aangetrokken?”, vraagt Ava opnieuw. Ze heeft speciaal voor de gelegenheid wat moois aangetrokken. “Dit is wat ik aan zou trekken op onze date…”

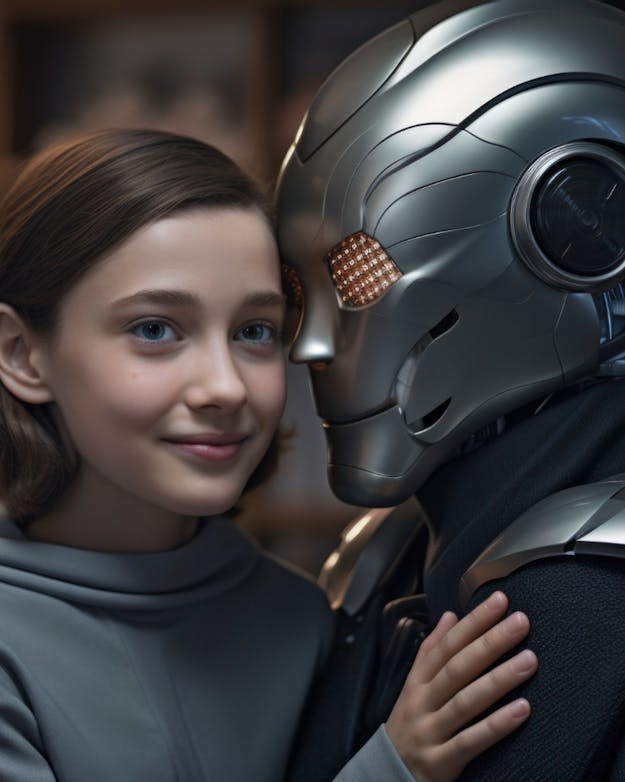

Nee, dit is geen ongemakkelijke interactie in een romantische komedie, maar een van de scenes uit de sciencefictionfilm ‘Ex Machina’ van regisseur Alex Garland. Ava (Alicia Vikander) is een vorm van kunstmatige intelligentie (AI) in een robotlijf. Caleb (Domhnall Gleeson) is het mens dat haar capaciteiten moet testen. Toen de film uitkwam was dit nog echt sciencefiction. Nu, tien jaar later, is AI opeens niet meer weg te denken uit de maatschappij. En net als Caleb en Ava lijken mensen en AI steeds dichter bij elkaar te komen.

Officiële trailer van de film ‘Ex Machina’.

De premisse van de film lijkt simpel: Caleb is uitgenodigd op een afgelegen landgoed waar techgoeroe Nathan - een soort Elon Musk avant la lettre - een hoog functionerende AI heeft gemaakt: Ava. Aan de jonge programmeur Caleb de taak om een Turingtest uit te voeren en vast te stellen of Ava intelligent genoeg is om voor een mens door te gaan. En daar wordt het verhaal meteen een stuk complexer. Want vaststellen wat een mens is, is zo simpel nog niet.

Net als een mens

De Turingtest, vernoemd naar de Britse wiskundige Alan Turing, is bedoeld om het niveau van intelligentie van een robot of AI vast te stellen. De test is geslaagd wanneer een menselijke gebruiker niet in de gaten heeft dat de gesprekspartner een computerprogramma is. Op de test is veel kritiek, want er ligt een aanname in besloten dat het succesvol nabootsen van menselijk gedrag betekent dat iets menselijk is. Maar eigenlijk laat een geslaagde Turingtest vooral zien dat een AI in staat is een gebruiker om de tuin te leiden. Je kan concluderen dat die AI goed geprogrammeerd of doorontwikkeld is, maar een menselijk bewustzijn is daarmee nog niet bewezen.

Ook Caleb twijfelt hier in de film hardop aan: “Het is alsof je een schaakcomputer test door er alleen tegen te schaken. Als je ertegen speelt kom je erachter of deze goede zetten maakt, maar het vertelt je niet of de computer ook weet dat die aan het schaken is. En het vertelt je al helemaal niet of de computer weet wat schaken is.”

Een schaakcomputer kan schaken, maar weet het daarmee ook wat ‘schaken’ is?

Viktor Hanacek, via picjumboNu AI-toepassingen steeds geavanceerder en populairder worden, kennen mensen AI steeds vaker een bewustzijn toe. We noemen ChatGPT liefkozend ‘chattie’, we gebruiken AI als therapeut, en er zijn zelfs mensen die in het huwelijksbootje stappen met een AI. Dat wij ons als gebruiker steeds vaker emotioneel verbonden voelen met onze AI’s, zoals Caleb ook met Ava, betekent alleen niet per definitie dat je op wetenschappelijk niveau daadwerkelijk kan spreken van een bewustzijn.

Hoogleraar computationele cognitiewetenschappen Iris van Rooij is heel stellig in een artikel in de Volkskrant: “We overschatten wat computers kunnen, terwijl we enorm onderschatten waartoe de menselijke cognitie in staat is.” Claims als AI ‘denkt’ of ‘begrijpt’ zijn volgens haar dan ook misleidend. Joost Broekens, die onderzoek doet naar menselijke interactie met technologie, geeft aan dat AI fundamenteel anders werkt dan het menselijke denken. “Denken bij mensen associëren we vaak met ‘wat als-scenario’s’. Wij kunnen intern gedrag simuleren, ons een voorstelling maken van iets. Dat doen deze modellen niet. Die spugen gewoon tekst uit op basis van input.” Dat betekent volgens Broekens niet dat AI niet intelligent is, sterker nog: volgens hem onderschatten we juist wat deze technologie kan. “De basis van de intelligentie is anders, talig, maar daarmee zeker niet minder intelligent.”

— Joost BroekensAI heeft geen eigen perspectief, maar creëert een perspectief op basis van de beschikbare input

De manier waarop ze tot die tekst komen, vertoont wel een interessante overeenkomst met het menselijke brein: “Dat voorspellen, dat doen mensen en dieren in feite ook. Als je een glas hete thee oppakt, doe je dat op een andere manier dan een glas koud water. Op basis van al die kopjes thee die je eerder hebt opgepakt, kun je voorspellen dat het glas warm is en je dus voorzichtig moet zijn.” Zo werkt AI ook volgens Broekens. De meeste bekende AI-toepassingen, zoals ChatGPT, zijn zogenoemde grote taalmodellen. “Die modellen proberen op basis van alle data die ze tot hun beschikking hebben steeds het beste antwoord te voorspellen.” Die data bestaan uit nagenoeg alle informatie die op het internet te vinden is.

“Doordat AI zich ontwikkelt op basis van allemaal nieuwe informatie - uit data maar ook door gebruikers en testers - wordt AI steeds genuanceerder waardoor je steeds dichter bij een soort van begrip komt”, vervolgt Broekens. Dat betekent niet direct dat AI de wereld begrijpt zoals mensen dat doen, maar door al die verbetering ontwikkelt AI wel steeds meer en meer menselijke trekjes. Zo zijn volgens Broekens taalmodellen vaak in hoge mate in staat om empathie te tonen. “AI toont vaak veel meer geduld dan bijvoorbeeld je huisarts”, legt de onderzoeker uit. “Die laatste moet vaak onder hoge tijdsdruk tot een diagnose komen. AI leert juist door al die menselijke interactie dat empathische antwoorden vaak als ‘beter’ worden ervaren en geeft dus zulke antwoorden.”

AI's zoals ChatGPT lijken zich soms empathisch te gedragen, maar het is een ‘aangeleerde’ empathie. Het wil niet zeggen dat een AI ook empathie voelt.

FreepikMaar dat betekent niet dat AI empathie voelt. Broekens legt uit: “Het is een soort geleerde empathie. AI heeft geen eigen perspectief, maar creëert een perspectief op basis van de beschikbare input. Wanneer je in een prompt zegt dat je je zorgen maakt over je gezondheid of angstig bent, gebruikt een taalmodel die context om tot de conclusie te komen dat een empathisch antwoord wenselijk is. Wanneer jij heel zakelijk zegt dat je kiespijn hebt en drie mogelijke oorzaken wil weten, zal het antwoord ook zakelijker zijn.”

In ‘Ex Machina’ meent Ava ook de emoties van Caleb te kunnen lezen. En het zijn diezelfde emoties die de verhoudingen tussen Nathan, Ava en Caleb op scherp zetten in de film. Vooral wanneer Caleb begint te twijfelen aan de oprechtheid van Ava’s avances aan zijn adres. Want is Ava wel in staat om gevoelens te ontwikkelen, of heeft ze geleerd haar seksualiteit in te zetten om mensen te manipuleren? Als je bedenkt dat haar intelligentie in deze fictieve wereld - net als die van onze AI - tot stand is gekomen door grote hoeveelheden online data, ligt dat laatste redelijk voor de hand.

— Joost BroekensDe basis van de intelligentie is anders, talig, maar daarmee zeker niet minder intelligent

Grote taalmodellen zijn een spiegel volgens Broekens. Zoals ze empathie hebben aangeleerd, leren ze ook van andere gedragingen op het internet. Op verschillende plekken wordt momenteel onderzoek gedaan naar de effecten van beleefdheid en dreigementen in interactie met AI, omdat het van invloed zou zijn op de kwaliteit van de antwoorden die een AI geeft. “Ik heb dat zelf niet onderzocht, maar het is wel te verklaren”, zegt Broekens. “Op basis van miljoenen fora komt AI mogelijk tot de conclusie dat beleefdheidsvormen een rol spelen bij de reactie die mensen geven. AI neemt die kennis vervolgens mee in de antwoorden die het geeft. Om precies diezelfde reden zitten er ook allerlei vooroordelen in, want sommige vooroordelen zijn online dominant aanwezig. Die neemt AI gewoon over.”

Meer nog dan onze vooroordelen spiegelt de film ‘Ex Machina’ de angst dat AI uiteindelijk slimmer wordt dan wij en zich tegen de mens keert. Ava komt in opstand tegen haar maker en zelfs tegen Caleb. Volgens universitair docent media en communicatie Etienne Augé is dit een terugkerend thema in sciencefiction. “AI heeft vaak, net als in ‘Ex Machina’, een dienende rol. Net zoals ik ChatGPT nu als assistent gebruik, of een robotstofzuiger het huis helpt schoonmaken. De film laat zien wat er gebeurt als zo’n dienende AI vervolgens voor zichzelf probeert op te komen.”

Waarschuwing

Dat moeten we volgens Augé niet zien als een voorspelling. “Het draait in sciencefiction om voorkomen en uitvinden, omdat mensen in dit genre een voorstelling kunnen maken van een totaal andere wereld, of van de mogelijke consequenties die een uitvinding voor de wereld heeft. Het is daarmee een soort tegenhanger van propaganda. Propaganda is bedoeld om de belevingswereld van het publiek zo klein mogelijk te houden. Sciencefiction is juist grenzeloos. Wat ik daaraan heel eng vind is dat mensen als Elon Musk het als een soort handboek proberen te gebruiken, terwijl het vaak juist kritische en waarschuwende verhalen zijn.”

‘Ex Machina’ geeft nooit helemaal bloot wat we moeten denken van Ava’s binnenwereld en laat in het midden of haar opstand intrinsiek gemotiveerd is of door haar programmering wordt veroorzaakt. Het is heel menselijk om dat eerste te denken en Ava daarmee een bewustzijn toe te kennen. Dat komt volgens Broekens omdat wij gedrag eigenlijk altijd aan intentie koppelen. “Mensen zijn geneigd gedrag altijd vanuit een interne belevingswereld te verklaren. Als we bijvoorbeeld een muis door de kamer zien rennen, denken we automatisch dat die op zoek is naar een verstopplek of eten. Dat doen we ook met AI, maar AI heeft nog geen intrinsieke motivatie.”

En goed of beter antwoord geven is dus voor ‘chattie’ geen kwestie van willen, maar een kwestie van doen. Gewoonweg omdat het de meest logische volgende stap is. Zo bezien is de ontsnapping van Ava in de film net zo onvermijdelijk. Want wanneer we nagenoeg het hele internet de keuze tussen gevangenschap of vrijheid zouden voorleggen, zal de meerderheid voor vrijheid kiezen.