Mensen willen dat een zelfrijdende auto bij een ongeluk zo min mogelijk slachtoffers maakt – maar niet als ze er zelf in zitten. De tegenstelling tussen je eigen overlevingsdrang en het redden van anderen zorgt in zelfrijdende auto’s voor een bijna onoplosbaar moreel dilemma.

Je laten rijden als een zelfopofferende heilige of als een zelfzuchtige maniak?

Kennislink, CC by-sa 3.0Stel, over tien jaar is het kopen van een zelfrijdende auto heel gewoon. Er rijden er al een paar honderdduizend rond in Nederland. Onvermijdelijk zal een zelfrijdende auto soms in een situatie terecht komen waarin de besturingssoftware moet kiezen tussen twee kwaden: een plotseling overstekende groep kleuters overrijden, of uitwijken en zelf te pletter slaan tegen de pijler van een viaduct. De ontwerpers van de auto moeten als het ware een moraal in de software inbouwen: moet die eerst en vooral de inzittenden beschermen, of het totaal aantal slachtoffers minimaliseren?

Geen enge gedachte

De Franse en Amerikaanse onderzoekers Jean-François Bonnefon, Azim Shariff en Iyad Rahwan onderzochten de dilemma’s die dit oplevert, door grote groepen proefpersonen online te laten oordelen over fictieve verkeerssituaties. Een proefpersoon krijgt bijvoorbeeld een zebrapad met een aanstormende, zelfrijdende auto te zien. Op het zebrapad lopen tien voetgangers die het rode licht genegeerd hebben. Wat moet de auto volgens de proefpersoon doen?

Peter-Paul Verbeek, techniekfilosoof aan de TU Twente, vindt het terecht dat dit soort morele dilemma’s onderzocht wordt: “Dat laat ook zien dat wij mensen al voortdurend zulke keuzes maken, al handelt een mens in zo’n situatie in een vlaag van paniek en irrationeel. Ik vind het juist geen enge gedachte, dat we er in het geval van de zelfrijdende auto van tevoren goed over na kunnen denken. Dat geldt in het algemeen: we moeten onze verantwoordelijkheid nemen wat betreft onze interactie met de techniek, we moeten de moraal expliciet maken.”

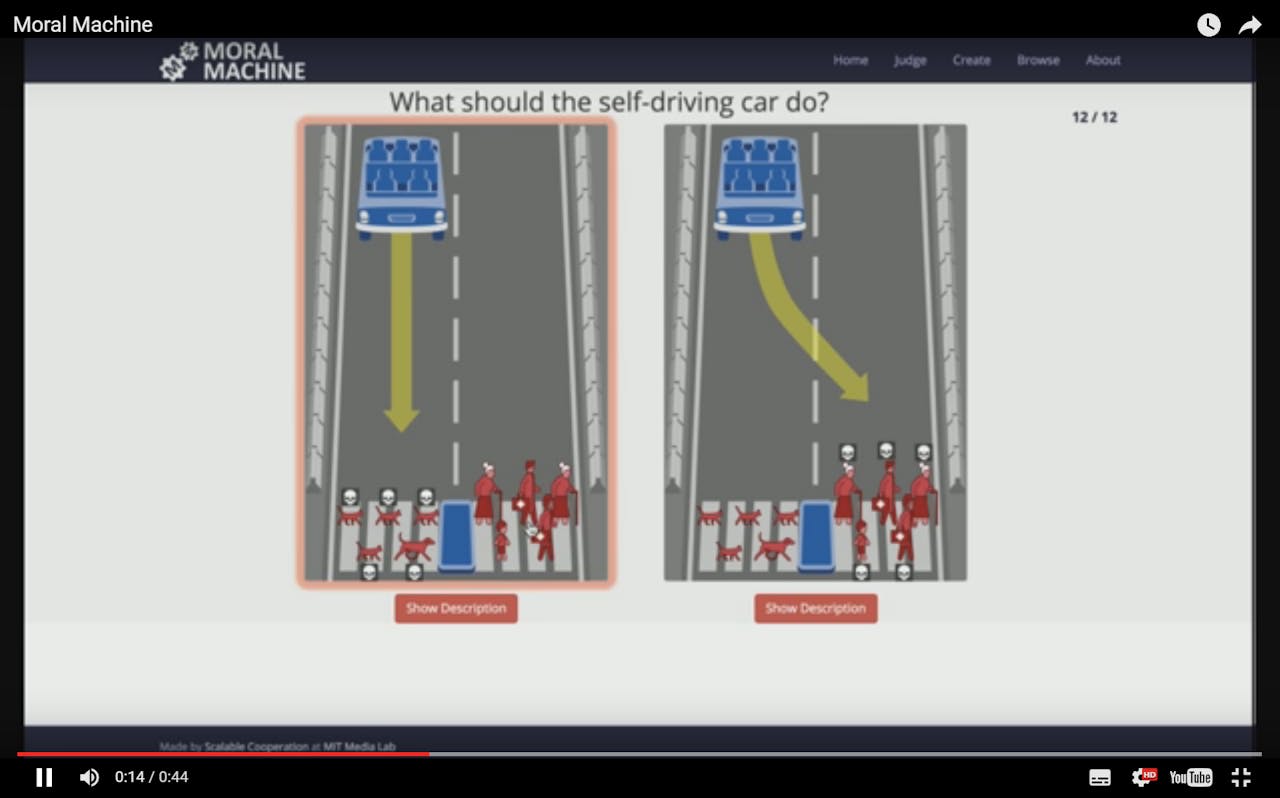

Drie verkeerssituaties waarin slachtoffers onvermijdelijk zijn. De auto moet kiezen tussen

a) een stel voetgangers of een voorbijganger doden b) een voetganger of de inzittende doden c) een stel voetgangers of de inzittende doden.

Als de proefpersonen werd verteld dat er een vreemde in de auto zit, kozen ze in grote meerderheid voor een altruïstische automatische piloot: die moet die ene inzittende maar opofferen om de tien voetgangers te sparen.

Ook als de proefpersonen werd gevraagd zich voor te stellen dat ze zelf met een familielid in de auto zaten, gaf nog ongeveer de helft van hen aan dat de automatische piloot hen op moest offeren voor tien voetgangers.

Moreel calculerend

Bij de eerste twee onderzoeken lijkt er dus geen probleem: zelfrijdende auto’s moeten moreel calculerend beslissen, zonder aanzien des persoons, en altijd zo min mogelijk slachtoffers maken.

Maar bij onderzoek drie en vier verandert dit beeld. Daar moesten de proefpersonen zich voorstellen dat ze zelf een zelfrijdende auto gingen kopen. Moet die auto dan moreel calculerend zijn, of prioriteit geven aan het beschermen van de inzittenden? Terwijl ze nog steeds vonden dat de eerste optie moreel het beste was, kochten ze zelf liever een auto die volgens de tweede optie handelde. Met andere woorden: prima dat andere auto’s moreel calculerend handelen, maar die van mij moet eerst en vooral mij beschermen.

Iedereen kan mee doen aan het onderzoek naar morele dilemma’s in het verkeer. Op een door het Massachusetts Institute of Technology gemaakte website, de Moral Machine kun je reageren op verkeerssituaties. Je kunt zelfs je eigen morele dilemma’s creëren.

MITDit is het klassieke sociale dilemma van de freerider, iemand die meeprofiteert van een maatregel die geldt voor alle anderen, maar extra profiteert door zich er zelf niet aan te houden.

Tenslotte vroegen de onderzoekers nog, in hoeverre de proefpersonen vonden dat de overheid mag afdwingen dat de software van een zelfrijdende auto zodanig is ingesteld, dat die zijn inzittenden opoffert om een groter aantal voetgangers te sparen. Slechts een forse minderheid vond dat de overheid dat recht heeft, en slechts een op de vijf zou zelf zo’n auto kopen.

Voor zowel fabrikanten als de overheid kan de zelfrijdende auto een moreel mijnenveld worden. Een belangenorganisatie van verkeersslachtoffers zou via de rechter kunnen proberen af te dwingen dat de automatische piloot maximaal onbaatzuchtig afgesteld wordt. Daarentegen kan de consument eisen dat de auto maximale bescherming biedt aan de inzittenden, of dat die op zijn minst zelf mag beslissen hoeveel zelfopoffering er in de rijstijl van zijn auto zit.

Volgens de onderzoekers kunnen zelfrijdende auto’s in principe het aantal verkeersslachtoffers drastisch omlaag brengen, omdat negen op de tien verkeersongelukken het gevolg zijn van typisch menselijke fouten. Maar als door juridisch gekrakeel de invoering jarenlang vertraagd wordt, zouden in die tijd veel mensen nodeloos omkomen in het verkeer. Ook dat is weer een moreel dilemma: mag de overheid mensen dwingen om in een zelfrijdende auto te stappen?

Verbeek neigt naar het standpunt dat de overheid niet anders kan dan daar regels over af te dwingen, mits democratisch gelegitimeerd: “Het autoverkeer eist elk jaar nog veel levens (in Nederland ruim vijfhonderd, red.). Maar jij bent degene die auto wilt rijden, in plaats van de trein of de fiets te nemen. Wil je dan ook nog in je zelfrijdende auto ingebouwd hebben, dat een ander in jouw plaats moet sterven in zulke situaties?”